チャットGPTショック ~ 日本の「前のめり」への憂慮

それらしく答えるチャットGPT

先日、知人がチャットGPTが回答した文章を見せてくれました。

知人の夫は大学教授で、学生がチャットGPTを利用して論文をまとめてくることへの対応(対策、指導?)を考える際の参考にするため、御自分と家族(著名)の名前を挙げてチャットGPTに「どういう人物か」回答を求めたのでした。

回答は、生年や専門分野などの客観的な事実に誤りが見られ、評価に関する部分は、まさに「知ったかぶりの人物がそれらしく答えている」たぐいのものでした。

チャットGPT(Generative Pre-trained Transformer 直訳すると「生成可能な事前学習済み変換器」)は、米国の新興企業「オープンAI」が2022年11月に無料公開した対話型の生成AIです。

インターネット上の膨大なデータを学習し、利用者の質問への回答、指示された文書の作成、文章の要約などを自然な文章で行うことができ、公開後わずかな期間で利用者が推計1億人に達したと言われています。

オープンAIの最高経営責任者アルトマン氏が来日して4月10日に岸田首相と面会し、また、今月29・30日に高崎市で開催される主要7カ国(G7)デジタル・技術相会合では、「AIガバナンスの推進」を掲げた行動計画の策定、5月の広島サミットでは対話型AIのあり方にに関する討議が予定されていることもあり、新聞紙面には連日のようにチャットGPTに関する記事が掲載されています。

前のめりの日本は欧米とは隔たりが

岸田首相がアルトマンCEOと会った翌日、西村経済産業相の「国家公務員の業務負担軽減ということで、国会答弁作成出の活用も視野に」という発言がありました。そのあまりに無批判(無邪気?)な姿勢には呆れるばかりです。

「責任あるAI」を標榜する上で危機管理の責任者であるはずの松本総務相は、「新しい技術というものは、使ってみなければわからない、まずは試みとして利用してみたい」と発言しており、日本政府の「(AI)研究遅れ 活用 前のめり」(朝日新聞4月22日)ぶりは際立っています。

これに対し、米欧は「偽情報懸念 規制も議論」(同紙)と、かなり違った様相を呈しています。

先頭を切ったのはイタリアで、チャットGPTの利用を一時的に禁止し、解除に必要な対応として、チャットGPTの学習に必要なデータの収集についての説明をサイト上に表示すること、EUの「一般データ保護規則」の基準に沿って個人の同意を得ることなどを命じています。

この流れを受け、EUのデータ保護当局でつくる「欧州データ保護会議」は、チャットGPTへの対応を協議する作業部会を設置しました。

EUとほぼ足並みを揃えて2021年からAIの規制に乗り出している米国も、このほど司法省など4つの規制当局が共同で「AI開発の監視を強化する」との声明を出しました。

チャットGPTの問題の根は深い

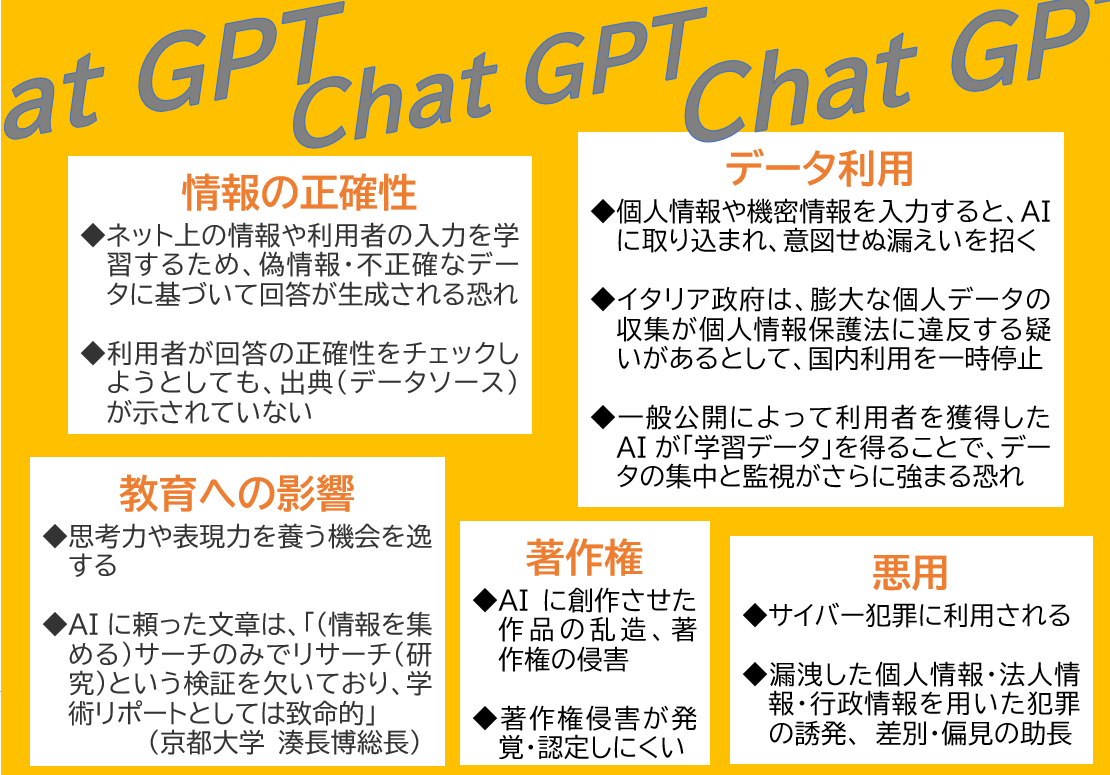

チャットGPTのような対話型・生成AIの問題点を下記の囲みに挙げました。5つの問題点の「見出し」は、4月11日放送のNHK『クローズアップ現代』で紹介されていたもので、その下の説明は複数社の新聞記事をもとにまとめました。

「教育への影響」の中に挙げた「思考力や表現力を養う機会を逸する」という懸念は、児童・生徒・学生に限ったことではありません。

チャットGPTのようなAIは、私たちが物事を考える時の「作法」を変えてしまう恐れがあります。現に私たちの多くは、情報を得る時にすぐに「検索」をします。今度は、検索の利便性どころではなく瞬時に「答え」を提供してもらえるのです。

与えられた答えが正しいかどうかを判断する力が試される、判断する力を付ければよいのだ、という識者コメントが氾濫しています。

しかし、どうやって答えが導き出されたのか、その経路はブラックボックスです。根拠となる出典・データソースは示されていません。

さらに深刻なのは、答えにたどり着く道筋を自分で探す、という物事を考える時の大事な作法を放り捨てて、「それらしい」答えを簡単に手に入れることに慣れてしまうことです。

それは、言葉を使って考える人間の本質的な部分が弱くなってしまうことに他なりません。

チャットGPTの登場と普及が私たちに及ぼす最も広範で最も深刻な影響はこの点です。

2番目に強く憂慮するのは、偽の情報・出所不明の怪情報だけでなく無害なもの、どうでもよいものも含め、AIが生成した膨大な量の情報がネット上に出回ることで、必要な情報の選別が難しくなってしまうことです。

EUなどが、個人情報保護の土台を揺るがす恐れやデータ集中の弊害を強く懸念しているのは至極まっとうで、私も同様の恐れや懸念を抱いていますが、個々の人間の思考パターンや大事なことの判断に関わる情報の選択への影響は、さらに根が深い問題ではないでしょうか。